AI 비디오 모델의 하드웨어 요구 사항은?

AI 비디오 생성을 로컬에서 실행하는 초보자 가이드

2026년에는 클라우드 구독 없이도 내 컴퓨터에서 직접 AI 영상을 생성할 수 있어요. 그런데 내 컴퓨터가 감당할 수 있을까요? 이 가이드는 모델별로 필요한 하드웨어를 정확히 알려드립니다 — 커뮤니티의 실제 벤치마크와 함께요.

14개 이상의 오픈소스 모델

VRAM 6GB부터 가능

Reddit 데이터 800개 이상

시작 전에: 핵심 개념 설명

AI 비디오 생성에는 기술적인 용어들이 등장해요. 각 용어가 실제로 무엇을 의미하는지 — 전문 용어 없이, 쉬운 말로 알려드릴게요.

VRAM (비디오 메모리)

주방 조리대 공간VRAM은 그래픽 카드에 있는 전용 메모리예요. 주방 조리대라고 생각해 보세요 — AI 모델은 재료들이고, 요리하려면 모든 재료가 동시에 조리대 위에 올라가 있어야 해요. VRAM이 클수록 더 큰 모델을 쓸 수 있고, 더 좋은 품질의 영상을 만들 수 있어요. 일반 RAM과는 완전히 별개의 메모리입니다.

확인 방법: 작업 관리자 → 성능 → GPU → 전용 GPU 메모리

RAM (시스템 메모리)

식품 창고 선반RAM은 컴퓨터의 주 메모리입니다 (마더보드에 꽂히는 메모리 스틱). VRAM이 부족할 때 넘치는 데이터가 여기에 저장돼요. 작동은 되지만, 창고에서 재료를 가져오는 건 조리대에서 바로 집는 것보다 느려요.

AI 비디오에는 최소 32GB. 48-64GB를 권장해요.

양자화 (GGUF / FP8)

사진을 JPEG로 압축하기양자화는 거대한 AI 모델을 작은 GPU에도 맞게 압축해요 — RAW 사진을 JPEG로 저장하는 것과 비슷해요. 파일은 훨씬 작아지고 품질 저하는 아주 약간이에요. GGUF Q4는 28GB 모델을 약 8GB로 줄여줘요. FP8은 절반인 약 14GB로 줄여줘요.

GGUF = 가장 유연하고 모든 GPU에서 작동해요. FP8 = RTX 40/50 시리즈에서 더 빠릅니다.

LoRA (저랭크 적응)

AI 모델용 인스타그램 필터LoRA는 모델의 동작 방식을 수정하는 작은 추가 파일이에요 (보통 200-600MB) — 스타일을 바꾸거나, 속도를 높이거나, 새로운 기능을 가르쳐요. Lightning LoRA는 필요한 스텝 수를 줄여 생성 시간을 70%까지 단축할 수 있어요.

Speed LoRA (Lightning, CausVid)는 느린 GPU에서 게임 체인저가 돼요.

스텝 (추론 스텝)

스케치 → 초안 → 완성 그림각 스텝마다 영상이 조금 더 정교해져요. 스텝이 많을수록 더 선명한 디테일을 얻을 수 있지만 기다리는 시간도 길어져요. 20스텝 생성은 5스텝보다 4배 더 걸려요. Speed LoRA를 쓰면 20스텝 대신 4-5스텝으로도 좋은 결과를 얻을 수 있어요.

Speed LoRA를 사용해 4-8스텝으로 시작하세요. 품질이 시간보다 중요할 때만 스텝을 늘리세요.

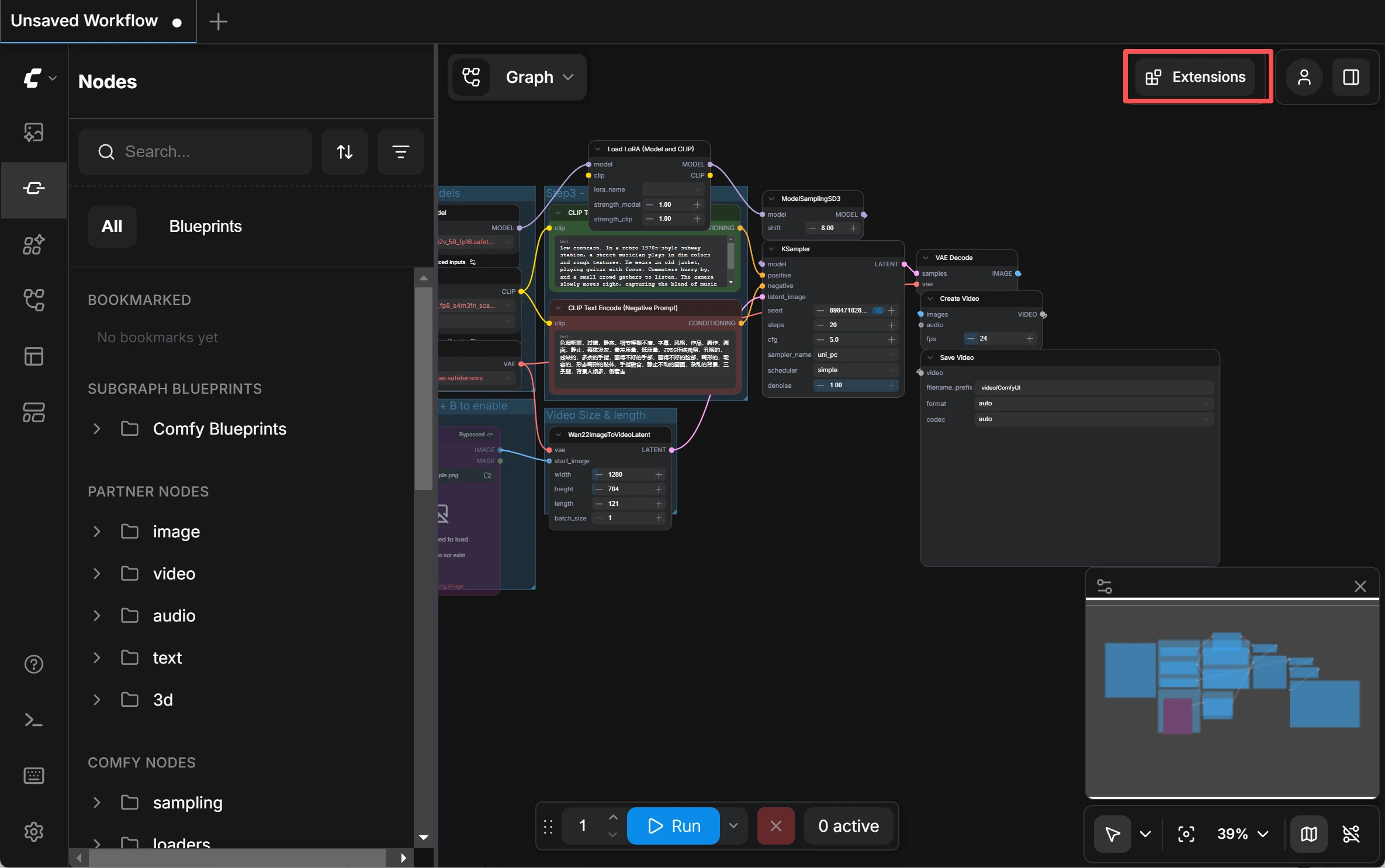

ComfyUI

모든 것이 이루어지는 작업실ComfyUI는 AI 비디오 모델을 로컬에서 실행하는 데 가장 많이 쓰이는 도구예요. 드래그 앤 드롭 노드 인터페이스를 갖춘 무료 오픈소스 프로그램입니다. 모델을 다운받고, 노드를 연결하고, 생성 버튼을 누르면 돼요. 대부분의 커뮤니티 워크플로우와 튜토리얼이 ComfyUI를 기준으로 만들어져 있어요.

github.com/comfyanonymous/ComfyUI 에서 무료로 다운받을 수 있어요

VRAM 등급: 내 GPU로 무엇을 실행할 수 있나요?

GPU의 VRAM이 가장 중요한 요소예요. 마케팅 스펙이 아닌, 실제 커뮤니티 테스트를 기반으로 각 등급에서 실행할 수 있는 것을 정확히 알려드릴게요.

GPUs

RTX 3090 · RTX 4090

Resolution

720p-1080p

Speed

5초 클립당 50초-4분

Compatible Models

거의 모든 모델 — WAN 14B (FP8) · LTX 2.3 · HunyuanVideo 1.5 · Mochi 1 · SkyReels V3 · CogVideoX-5B

2026년의 황금 기준이에요. 24GB에서는 모델을 고를 필요가 없어요 — 모두 들어가니까요. FP8이 네이티브로 실행되고, 품질이 높게 유지되며, 트릭 없이 720p를 생성할 수 있어요. 커뮤니티가 한목소리로 추천하는 단계예요.

"The RTX 4090 remains the king of local video generation" — GPU benchmarks with 199 upvotes

Generated with just 4GB VRAM and 16GB RAM

2026 오픈소스 AI 비디오 모델: 전체 지형도

이제 로컬에서 실행할 수 있는 오픈소스 영상 모델이 14개 이상이에요. 각 모델이 무엇을 가장 잘하는지, 어떤 하드웨어가 필요한지 한눈에 볼 수 있어요.

빅 3

2026년 가장 뛰어나고, 가장 많이 테스트되고, 커뮤니티 지원이 가장 풍부한 모델들이에요.

WAN 2.2

Alibaba품질의 왕

최고의 포토리얼리즘과 인간 움직임. 고노이즈와 저노이즈 전문 모듈이 분리된 Mixture-of-Experts 아키텍처. LoRA, 워크플로우, 튜토리얼이 가장 많은 커뮤니티 생태계.

Min VRAM

6GB (GGUF Q4)

Recommended

24GB

Speed (5s/720p)

50초-4분

Quality

9/10

LTX 2.3

Lightricks속도의 악마

단연 가장 빠른 생성 — 4090에서 거의 실시간에 가까워요. 텍스트-투-비디오, 이미지-투-비디오, 네이티브 오디오 동기화 지원. Apache 2.0 라이선스. Fast Flow 및 Pro Flow 모드.

Min VRAM

8GB (quantized)

Recommended

24-32GB

Speed (5s/720p)

30초 미만

Quality

8/10

HunyuanVideo 1.5

Tencent물리 엔진

가장 자연스러운 움직임과 물리 효과 — 물, 연기, 천의 움직임이 실감나요. v1.5에서 파라미터를 13B에서 8.3B로 줄이고, 오프로딩으로 VRAM 요구량을 47GB에서 14GB로 낮췄어요.

Min VRAM

14GB (offload)

Recommended

24GB

Speed (5s/720p)

3-5분

Quality

8/10

떠오르는 모델

독특한 방향으로 경계를 넓히고 있는 신규 모델들이에요.

FramePack

6GBVRAM의 기적 · Stanford (Lvmin Zhang)

ControlNet 제작자의 작품. 혁신적인 프레임 압축 기술로 6GB VRAM에서도 13B 모델을 실행할 수 있어요. 프레임 단위로 생성하기 때문에 영상 길이가 늘어나도 VRAM 사용량이 늘어나지 않아요.

DaVinci MagiHuman

6GB (block swap)비디오 + 오디오 동시 생성 · SII-GAIR & Sand.ai

영상과 오디오를 동시에 생성하는 Single-stream Transformer. 모든 모달리티에 걸쳐 파라미터를 공유하는 40레이어 아키텍처. H100에서 5초 1080p를 38초에 생성.

CogVideoX-5B

8GB (FP8)최고의 이미지-투-비디오 · Tsinghua / Zhipu AI

오픈 모델 중 프롬프트 반영률이 가장 높아요. Flux로 히어로 이미지를 만들고 CogVideoX로 애니메이션화하세요. 효율적인 압축을 위한 3D Causal VAE.

Mochi 1

20GB (FP8)가장 자연스러운 움직임 · Genmo AI

비대칭 Diffusion Transformer로 오픈 모델 중 가장 자연스러운 움직임 물리를 구현해요. 물이 진짜 난류처럼 흐르고, 천이 자연스럽게 흔들려요. Apache 2.0 라이선스.

SkyReels V3

24GB멀티모달 시네마 · Skywork AI

WAN 2.1 아키텍처 기반으로 레퍼런스 이미지에서 다중 피사체 생성과 오디오 기반 영상을 지원해요. V4 (프리뷰)는 1080p/32FPS에서 영상+오디오 동시 생성을 추가했어요.

초보자 친화적 모델

하드웨어가 제한적이거나 AI 비디오를 처음 접한다면 여기서 시작하세요.

WAN 1.3B

WAN 생태계로 들어가는 가장 가벼운 방법이에요. 품질은 낮지만 거의 모든 장치에서 실행돼요.

LTX-Video 2B

초고속 경량 버전이에요. 오래 기다리지 않고 ComfyUI 워크플로우를 배우기에 딱 좋아요.

AnimateDiff

Stable Diffusion에 연결해서 사용해요. 기존에 쓰던 체크포인트와 LoRA가 그대로 작동하고 — 움직임만 추가해요.

WAN VACE

올인원: 생성, 편집, 인페인트, 스타일 트랜스퍼 모두 가능. 모델을 하나만 설치한다면 이게 최선일 수도 있어요.

숨겨진 병목: RAM과 스토리지

VRAM이 주목을 받지만, RAM이나 스토리지가 부족하면 퍼포먼스가 조용히 망가져요.

시스템 RAM: 생각보다 더 필요해요

메모리 부족 오류와 잦은 크래시. ComfyUI가 모델을 로드한 상태로 유지하기 어려워요.

GGUF Q4 모델에서는 작동해요. 더 큰 모델이나 여러 워크플로우에서는 한계에 부딪혀요.

대부분의 사용자에게 딱 좋은 단계예요. CPU 오프로딩으로 FP8 모델이 원활하게 실행돼요.

메모리 걱정 없이 모든 모델 구성을 실행할 수 있어요. 더 큰 모델에도 미래 대비가 돼요.

"I upgraded to 48 GB. It makes a huge difference" — Reddit user running LTX-2 on RTX 3060 12GB

Windows 페이지 파일 팁

RAM이 부족한가요? Windows 가상 메모리를 40-50GB로 설정하세요. SSD를 비상 RAM으로 활용해요 — 느리지만 크래시를 방지해줘요. 다만 SSD가 더 빨리 닳는다는 점을 알아두세요.

스토리지: NVMe SSD 필수

AI 비디오 모델은 용량이 커요 — 모델 하나가 8-28GB일 수 있어요. 컬렉션으로 모으면 쉽게 100GB를 넘어요. NVMe SSD를 사용하세요 — 하드 드라이브에서 모델을 불러오면 매번 생성할 때마다 몇 분씩 추가돼요. 모델 전용으로만 최소 500GB의 빠른 스토리지를 확보하세요.

업그레이드 예산이 없다면? 하드웨어를 최대한 쥐어짜세요

커뮤니티에서 검증된 이 기술들은 돈 한 푼 쓰지 않고도 경험을 크게 향상시킬 수 있어요.

GGUF 양자화

VRAM 50-80% 절감저VRAM 사용자를 위한 1순위 기술이에요. 28GB 모델을 8GB(Q4)로 압축하고 품질 손실은 최소화해요. 8-12GB GPU에 필수적이에요.

함정: RTX 40/50 시리즈에서는 하드웨어 가속이 없어 GGUF가 FP8보다 느려요. 모델이 VRAM에 맞지 않을 때만 GGUF를 사용하세요.

Speed LoRA (Lightning / CausVid)

시간 60-70% 단축Lightning LoRA는 추론 스텝을 20에서 4-5로 줄여요. 15분 걸리던 생성이 5분으로 줄어들어요. Rank 64 버전이 Rank 32보다 움직임 품질을 더 잘 유지해요.

SageAttention 2

10-20% 더 빠름바로 적용 가능한 어텐션 최적화예요. 설치하고, 활성화하고, 무료 속도 향상을 즐기세요. 가장 최신 버전인 Radial-Sage Attention은 벤치마크에서 95초 대비 74초로 추가로 20%를 더 올려줘요.

저해상도 생성 후 업스케일

3-5배 더 빠름480p로 생성 후 Topaz 또는 SeedVR2로 720p나 1080p로 업스케일하세요. 네이티브 고해상도와 거의 구분할 수 없는 결과물이 훨씬 짧은 시간에 나와요.

Torch Compile

무료 속도 향상모델 실행을 최적화하는 한 줄짜리 플래그예요. 품질 손실 없이 눈에 띄는 속도 향상. PyTorch 2.8+가 필요해요.

FP16 Accumulation (RTX 40/50)

약 20% 더 빠름RTX 40/50 시리즈 전용 하드웨어 가속 최적화예요. 약 5% 품질 저하로 약 20% 속도 향상. --fast fp16_accumulation 플래그로 활성화하세요.

GPU 구매 vs 클라우드 렌탈?

정답은 없어요 — 얼마나 자주 사용할지에 따라 달라요.

내 GPU 구매

장점

시간당 비용 없음 — 원할 때마다 생성 가능

지연 없음 — 업로드/다운로드 대기 없음

완전한 프라이버시 — 내 컴퓨터 밖으로 데이터가 나가지 않아요

다른 용도로도 활용 가능 (게임, 다른 AI 작업)

단점

높은 초기 비용 ($750-$2,500+)

전기 요금이 쌓여요

새 GPU 출시에 따라 가치가 떨어져요

중고 RTX 3090

24GB VRAM · 2026년 VRAM 대비 최고의 가성비

RTX 5060 Ti

16GB VRAM · FP4 지원의 저렴한 신품 카드

RTX 5090

32GB VRAM · 최고의 소비자용 GPU, 4090보다 50% 빠름

클라우드 GPU 렌탈

장점

초기 투자 없음

최고급 하드웨어 접근 (5090, A100, H100)

필요에 따라 확장 또는 축소 가능

구매 전 체험 — 결정 전에 하드웨어 테스트 가능

단점

시간이 지나면 지속 비용이 쌓여요

파일 업로드/다운로드 지연

인터넷 연결에 의존해요

RunPod

가장 인기 있는 서비스, 훌륭한 생태계

Vast.ai

가장 저렴하지만 품질이 들쭉날쭉해요

ComfyUI Cloud

설정 불필요, 즉시 사용 가능

Modal

가볍게 또는 가끔 사용하기에 좋아요

ComfyUI — the most popular open-source tool for running AI video models locally

손익분기점

주 15시간 사용 시 RunPod 비용은 연 약 $500이에요. 중고 RTX 3090은 한 번에 $750이고요. 18개월 이상 사용할 계획이라면 구매가 유리해요. 그냥 실험해보는 거라면 먼저 렌탈해보세요 — 빠져들면 그때 구매하면 돼요.

AI 비디오를 위한 추천 빌드

세 가지 예산 등급별 구체적인 부품과 가능한 작업을 알려드릴게요.

입문 빌드

약 $600-800모든 주요 모델을 FP8로 실행. 720p 생성이 2-6분. 가장 가성비 좋은 빌드예요.

미드레인지 빌드

약 $1,200-1,500커뮤니티 표준 사양. 720p를 2분 이내에 생성. 트릭을 사용하면 1080p도 가능. 모델 교체 없이 여러 모델을 실행할 수 있어요.

미래 대비 빌드

약 $2,500+타협 없음. 풀 정밀도 모델, 1080p 네이티브, 60초 미만 생성. FP4 하드웨어 가속. 차세대 모델도 준비돼 있어요.

Apple Silicon 대안

M3/M4 Ultra 탑재 Mac Studio (최대 512GB 통합 메모리)는 소비자용 GPU에 올라가지 않는 대형 모델도 실행할 수 있어요. 단점: 대역폭이 느려 (H100의 3,350 GB/s 대비 400-800 GB/s) 스텝당 생성 속도가 2-3배 더 느려요.