Quais São os Requisitos de Hardware para Modelos de Vídeo IA?

Guia para Iniciantes sobre Como Rodar Geração de Vídeo IA Localmente

Em 2026, você pode gerar vídeos com IA direto no seu computador — sem precisar de assinatura em nuvem. Mas o SEU computador aguenta? Este guia detalha exatamente qual hardware você precisa, modelo por modelo, com benchmarks reais da comunidade.

Mais de 14 Modelos Open-Source

A partir de 6GB de VRAM

Mais de 800 Pontos de Dados do Reddit

Antes de Começar: Conceitos-Chave Explicados

A geração de vídeo IA envolve alguns termos técnicos. Aqui está o que eles realmente significam — sem jargão, em linguagem simples.

VRAM (Memória de Vídeo)

O espaço da sua bancada de cozinhaVRAM é a memória dedicada da sua placa de vídeo. Pense nela como a bancada da sua cozinha — o modelo de IA são os ingredientes, e todos precisam caber na bancada ao mesmo tempo para cozinhar. Mais VRAM = modelos maiores = vídeos de melhor qualidade. É completamente separada da sua RAM comum.

Veja a sua: Gerenciador de Tarefas → Desempenho → GPU → Memória GPU Dedicada

RAM (Memória do Sistema)

A sua dispensaRAM é a memória principal do seu computador (os pentes na placa-mãe). Quando a bancada de VRAM é pequena demais, os ingredientes excedentes ficam guardados aqui. Funciona, mas pegar itens da dispensa é mais lento do que tê-los na bancada.

32GB é o mínimo para vídeo IA. 48-64GB recomendado.

Quantização (GGUF / FP8)

Comprimir uma foto para JPEGA quantização reduz um modelo de IA enorme para caber em GPUs menores — similar a salvar uma foto RAW como JPEG. O arquivo fica muito menor com uma pequena perda de qualidade. GGUF Q4 reduz um modelo de 28GB para ~8GB. FP8 corta pela metade, deixando em ~14GB.

GGUF = mais flexível, funciona em qualquer GPU. FP8 = mais rápido nas séries RTX 40/50.

LoRA (Low-Rank Adaptation)

Um filtro do Instagram para o seu modelo de IALoRAs são pequenos arquivos complementares (geralmente 200-600MB) que modificam o comportamento de um modelo — alterando o estilo, acelerando ou ensinando novos truques. Lightning LoRAs podem reduzir o tempo de geração em 70% ao diminuir o número de passos necessários.

Speed LoRAs (Lightning, CausVid) são revolucionárias para GPUs lentas.

Passos (Inference Steps)

Esboço → Rascunho → Pintura finalCada passo refina o vídeo um pouco mais. Mais passos = detalhes mais nítidos, mas espera maior. Uma geração de 20 passos demora 4x mais que uma de 5 passos. Speed LoRAs permitem obter bons resultados em apenas 4-5 passos em vez de 20.

Comece com 4-8 passos usando uma speed LoRA. Só aumente se a qualidade for mais importante que o tempo.

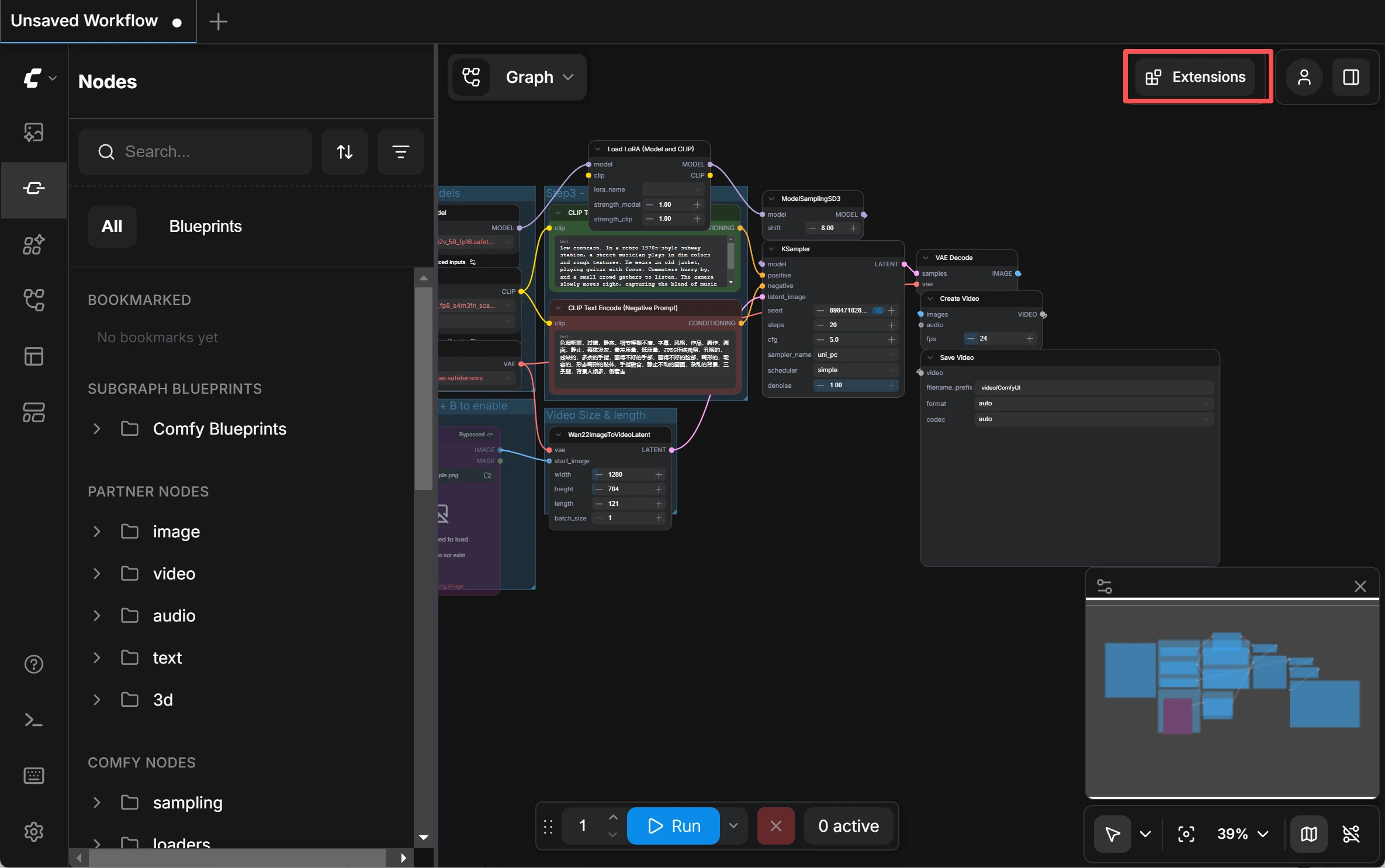

ComfyUI

A oficina onde tudo aconteceComfyUI é a ferramenta mais popular para rodar modelos de vídeo IA localmente. É um programa gratuito e open-source com uma interface de nós drag-and-drop. Você baixa os modelos, conecta os nós e clica em Gerar. A maioria dos workflows e tutoriais da comunidade foi feita para o ComfyUI.

Download gratuito em github.com/comfyanonymous/ComfyUI

Faixas de VRAM: O Que Sua GPU Consegue Rodar?

A VRAM da sua GPU é o fator mais importante. Aqui está exatamente o que você pode rodar em cada faixa — baseado em testes reais da comunidade, não em especificações de marketing.

GPUs

RTX 3090 · RTX 4090

Resolution

720p-1080p

Speed

50s-4 min por clipe de 5s

Compatible Models

Quase tudo — WAN 14B (FP8) · LTX 2.3 · HunyuanVideo 1.5 · Mochi 1 · SkyReels V3 · CogVideoX-5B

O padrão ouro de 2026. Com 24GB, você nunca precisa escolher entre modelos — todos cabem. FP8 roda nativamente, a qualidade se mantém alta e você gera em 720p sem truques. Esta é a faixa que a comunidade recomenda universalmente.

"The RTX 4090 remains the king of local video generation" — GPU benchmarks with 199 upvotes

Generated with just 4GB VRAM and 16GB RAM

Modelos de Vídeo IA Open-Source em 2026: O Panorama Completo

Agora existem mais de 14 modelos de vídeo open-source que você pode rodar localmente. Aqui está o quadro completo — o que cada um faz de melhor e qual hardware ele precisa.

Os Três Grandes

Os modelos mais capazes, mais testados e com maior suporte da comunidade em 2026.

WAN 2.2

AlibabaO Rei da Qualidade

Melhor fotorrealismo e movimentação humana. Arquitetura Mixture-of-Experts com especialistas separados para alto e baixo ruído. Maior ecossistema da comunidade com os mais LoRAs, workflows e tutoriais.

Min VRAM

6GB (GGUF Q4)

Recommended

24GB

Speed (5s/720p)

50s-4min

Quality

9/10

LTX 2.3

LightricksO Demônio da Velocidade

Geração mais rápida de longe — quase em tempo real num 4090. Suporta text-to-video, image-to-video e sincronização de áudio nativa. Licença Apache 2.0. Modos Fast Flow e Pro Flow.

Min VRAM

8GB (quantizado)

Recommended

24-32GB

Speed (5s/720p)

<30s

Quality

8/10

HunyuanVideo 1.5

TencentO Motor de Física

Movimentação e física mais naturais — água, fumaça e tecidos se movem de forma convincente. A v1.5 reduziu os parâmetros de 13B para 8.3B e a VRAM necessária de 47GB para 14GB com offloading.

Min VRAM

14GB (offload)

Recommended

24GB

Speed (5s/720p)

3-5min

Quality

8/10

Estrelas em Ascensão

Modelos mais recentes que empurram os limites em direções únicas.

FramePack

6GBO Milagre da VRAM · Stanford (Lvmin Zhang)

Do criador do ControlNet. A compressão revolucionária de frames permite rodar modelos 13B com 6GB de VRAM. Gera frame por frame, então o comprimento do vídeo não aumenta o uso de VRAM.

DaVinci MagiHuman

6GB (block swap)Vídeo + Áudio Juntos · SII-GAIR & Sand.ai

Transformer de stream único que gera vídeo E áudio simultaneamente. Arquitetura de 40 camadas com parâmetros compartilhados entre todas as modalidades. 5s em 1080p em 38s no H100.

CogVideoX-5B

8GB (FP8)Melhor Image-to-Video · Tsinghua / Zhipu AI

Melhor aderência aos prompts entre os modelos open. Gere uma imagem principal com Flux e anime com CogVideoX. VAE Causal 3D para compressão eficiente.

Mochi 1

20GB (FP8)Movimentação Mais Natural · Genmo AI

O Asymmetric Diffusion Transformer produz a física de movimento mais natural de qualquer modelo open. A água flui com turbulência genuína, tecidos ondulam naturalmente. Licença Apache 2.0.

SkyReels V3

24GBCinema Multi-Modal · Skywork AI

Construído na arquitetura WAN 2.1 com geração multi-sujeito a partir de imagens de referência e vídeo guiado por áudio. V4 (preview) adiciona vídeo+áudio simultâneos em 1080p/32FPS.

Amigáveis para Iniciantes

Comece aqui se tiver hardware limitado ou for completamente novo no vídeo IA.

WAN 1.3B

A forma mais leve de entrar no ecossistema WAN. A qualidade é menor, mas roda em quase qualquer coisa.

LTX-Video 2B

Variante leve ultra-rápida. Ótima para aprender workflows no ComfyUI sem esperar uma eternidade.

AnimateDiff

Se encaixa no Stable Diffusion. Seus checkpoints e LoRAs favoritos continuam funcionando — ele só adiciona movimento.

WAN VACE

Tudo em um: gerar, editar, inpainting, transferência de estilo. Se você for instalar só um modelo, pode ser esse.

O Gargalo Oculto: RAM e Armazenamento

A VRAM recebe toda a atenção, mas RAM insuficiente ou armazenamento lento podem silenciosamente arruinar seu desempenho.

RAM do Sistema: Mais do Que Você Imagina

Travamentos constantes e erros de falta de memória. O ComfyUI vai ter dificuldade para manter os modelos carregados.

Funciona para modelos GGUF Q4. Você vai atingir os limites com modelos maiores ou múltiplos workflows.

O ponto ideal para a maioria dos usuários. Modelos FP8 com CPU offloading rodam sem problemas.

Rode qualquer configuração de modelo sem se preocupar com memória. À prova do futuro para modelos maiores.

"I upgraded to 48 GB. It makes a huge difference" — Reddit user running LTX-2 on RTX 3060 12GB

Truque do Arquivo de Paginação do Windows

Está com pouca RAM? Defina a memória virtual do Windows para 40-50GB. Ele usa seu SSD como RAM de emergência — mais lento, mas evita travamentos. Só saiba que isso desgasta o SSD mais rápido com o tempo.

Armazenamento: SSD NVMe Obrigatório

Modelos de vídeo IA são grandes — um único modelo pode ter 8-28GB. Uma coleção facilmente ultrapassa 100GB. Use um SSD NVMe — carregar modelos de um HD adiciona minutos a cada geração. Reserve pelo menos 500GB de armazenamento rápido só para os modelos.

Sem Orçamento para Upgrade? Tire Mais do Seu Hardware

Essas técnicas testadas pela comunidade podem melhorar drasticamente sua experiência sem gastar um centavo.

Quantização GGUF

Reduz VRAM em 50-80%A técnica #1 para usuários com pouca VRAM. Comprime um modelo de 28GB para 8GB (Q4) com perda mínima de qualidade. Essencial para GPUs de 8-12GB.

Armadilha: GGUF é mais lento que FP8 nas séries RTX 40/50 por falta de aceleração de hardware. Só use GGUF se o modelo não couber na VRAM de outra forma.

Speed LoRAs (Lightning / CausVid)

Reduz o tempo em 60-70%Lightning LoRAs reduzem os passos de inferência de 20 para 4-5. Uma geração de 15 minutos vira 5 minutos. Versões Rank 64 preservam melhor a qualidade do movimento do que as Rank 32.

SageAttention 2

10-20% mais rápidoOtimização de atenção drop-in. Instale, ative e aproveite a velocidade grátis. Radial-Sage Attention (mais recente) acrescenta mais 20% em cima: 74s vs 95s nos benchmarks.

Gere em Baixa Resolução, Faça Upscale Depois

3-5x mais rápidoGere em 480p e faça upscale para 720p ou 1080p usando Topaz ou SeedVR2. Os resultados são quase indistinguíveis do nativo em alta resolução, em uma fração do tempo.

Torch Compile

Boost de velocidade grátisUma flag de uma linha que otimiza a execução do modelo. Zero perda de qualidade, melhoria de velocidade perceptível. Requer PyTorch 2.8+.

FP16 Accumulation (RTX 40/50)

~20% mais rápidoOtimização com aceleração de hardware exclusiva para as séries RTX 40/50. Adiciona ~20% de velocidade com ~5% de trade-off na qualidade. Ative com a flag --fast fp16_accumulation.

Comprar uma GPU ou Alugar na Nuvem?

Não há uma resposta universal — depende de quanto você vai usar.

Compre Sua Própria GPU

Prós

Sem custo por hora — gere quando quiser

Zero latência — sem espera de upload/download

Privacidade total — nada sai do seu computador

Útil para outras tarefas (jogos, outros trabalhos com IA)

Contras

Alto custo inicial ($750-$2.500+)

Custos de eletricidade se acumulam

O hardware se deprecia conforme novas GPUs são lançadas

RTX 3090 usado

24GB VRAM · Melhor custo-benefício por VRAM em 2026

RTX 5060 Ti

16GB VRAM · Placa nova econômica com suporte a FP4

RTX 5090

32GB VRAM · Melhor GPU para consumidor, 50% mais rápida que a 4090

Alugue GPUs na Nuvem

Prós

Sem investimento inicial

Acesso a hardware de ponta (5090, A100, H100)

Escale para cima ou para baixo conforme necessário

Teste antes de comprar — experimente o hardware antes de se comprometer

Contras

Custos contínuos se acumulam com o tempo

Latência de upload/download para arquivos

Depende da conexão com a internet

RunPod

O mais popular, ótimo ecossistema

Vast.ai

O mais barato, qualidade variável

ComfyUI Cloud

Zero configuração, pronto para usar

Modal

Ótimo para uso leve/ocasional

ComfyUI — the most popular open-source tool for running AI video models locally

O Ponto de Equilíbrio

Com 15 horas por semana, o RunPod custa ~$500/ano. Um RTX 3090 usado custa $750 uma vez. Se você for usar por mais de 18 meses, comprar vence. Se estiver só experimentando, alugue primeiro — então compre quando estiver viciado.

Configurações Recomendadas para Vídeo IA

Três faixas de orçamento com peças específicas e o que cada uma consegue fazer.

Configuração Básica

~$600-800Rode todos os principais modelos em FP8. Geração em 720p em 2-6 minutos. A melhor configuração custo-benefício que você pode ter.

Configuração Intermediária

~$1.200-1.500O padrão da comunidade. 720p em menos de 2 minutos. 1080p possível com truques. Rode vários modelos sem precisar trocar.

Configuração À Prova do Futuro

~$2.500+Sem compromissos. Modelos em precisão total, 1080p nativo, geração em menos de 60 segundos. Aceleração de hardware FP4. Pronto para modelos de próxima geração.

Alternativa Apple Silicon

Mac Studio com M3/M4 Ultra (até 512GB de memória unificada) consegue rodar modelos grandes que não cabem em GPUs para consumidor. Trade-off: largura de banda menor (400-800 GB/s vs 3.350 GB/s no H100) significa geração 2-3x mais lenta por passo.

Perguntas Frequentes

Pule a Dor de Cabeça com Hardware

Não quer se preocupar com VRAM, drivers e compatibilidade? Experimente nosso gerador de vídeo IA online — sem necessidade de GPU. Teste grátis com cadastro, sem revisão de conteúdo, resultados instantâneos.

Sem Necessidade de GPU

Roda nos nossos servidores — funciona em qualquer dispositivo

Teste Grátis

Cadastre-se e comece a gerar imediatamente

Sem Revisão de Conteúdo

Suas criações são privadas e sem restrições

Múltiplos Modelos

Acesse os principais modelos sem baixar nada